Extrahieren Sie Text aus Bildern mit Vision AI

OCR hat sich in den Jahren 2024-2026 vollständig verändert

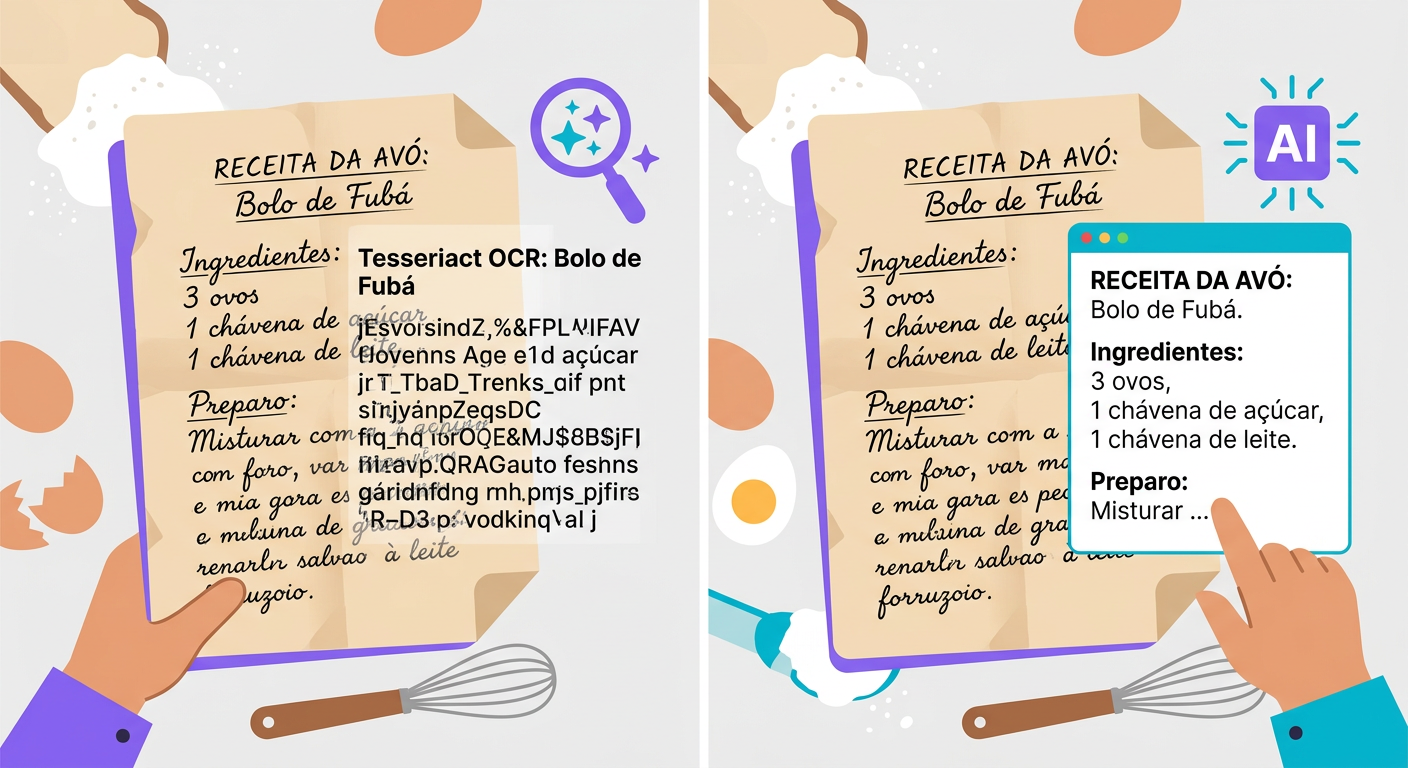

Traditionelles OCR (Tesseract, seit 1985) funktioniert in 2 Schritten:

1. Erkennung: findet Bereiche im Bild, die Text enthalten

2. Wiedererkennung: klassifiziert jeden Buchstaben einzeln

Es funktioniert gut bei sauberen gedruckten Dokumenten, mit gängigen Schriftarten, auf Englisch. In jedem anderen Szenario (Handschrift, gekrümmte Schilder, Text in Fotos, exotische Sprachen, komplexe Layouts) sinkt die Genauigkeit auf 60–70 %.

Die modernen Vision-Language-Modelle (Claude Sonnet, GPT-5, Gemini 3 Pro) haben OCR revolutioniert. Anstatt Buchstabe für Buchstabe zu klassifizieren, interpretieren sie das Bild als Ganzes — sie erkennen Kontext, korrigieren Fehler auf Basis von Bedeutung und bewältigen beliebige Layouts.

Wann welches Tool verwendet werden soll ESRGAN: Für die Verbesserung der Bildqualität und Hochskalierung von Bildern mit niedriger Auflösung. BiRefNet: Für die präzise Hintergrundsegmentierung und -entfernung aus Bildern. Whisper: Für die Transkription von Audio in Text (STT) mit Unterstützung mehrerer Sprachen. TTS: Für die Umwandlung von Text in natürlich klingende Sprache. STT: Für die Echtzeit-Spracherkennung und Umwandlung von gesprochenem Text. API: Für die Integration externer Dienste und die Kommunikation zwischen verschiedenen Systemen. LLM: Für die Verarbeitung natürlicher Sprache, Textgenerierung und komplexe Konversationsaufgaben.

Tesseract (Open Source, lokal CPU):

- Standardisierte gedruckte Dokumente (Invoices, gescannte PDFs)

- Hohes Volumen (10k+ Seiten/Tag), wo Latenz eine Rolle spielt

- Fälle, in denen Datenschutz das Senden in die Cloud verhindert

- Kosten: praktisch null

Vision-LLM (via API):

- Handgeschriebener Text

- Schilder, Plakate, Straßenfotos

- Texte auf 3D-Objekten (Dosen, gebogene Etiketten)

- Dokumente mit komplexem Layout (Tabellen, mehrere Spalten, Fußnoten)

- Sprachen mit wenigen Ressourcen (Arabisch, Chinesisch, Hebräisch)

- Kosten: R$ 0,005 bis R$ 0,05 pro Bild

Whisper-OCR (spezialisiertes Modell):

- Dokumente mit vielen Tabellen

- Mathematische Gleichungen

- Wissenschaftliche Layouts (Papers)

Wie man eine gute Anfrage stellt

Damit vision-LLM besser funktioniert, strukturieren Sie den Prompt:

Schlecht:

> "OCR this"

Gut:

> "Extrahieren Sie den gesamten sichtbaren Text in diesem Bild und bewahren Sie dabei die hierarchische Struktur (Titel, Untertitel, Absätze). Falls eine Tabelle vorhanden ist, formatieren Sie diese in Markdown. Falls der Text in einem Bereich unleserlich ist, geben Sie [unleserlich] an. Falls Text in mehreren Sprachen vorhanden ist, trennen Sie diese."

Der Qualitätsunterschied ist dramatisch. Das LLM nutzt sein „Verständnis" der Struktur, um den Output zu organisieren.

Praktische Anwendungsfälle

- Digitalisierung historischer Archive: handgeschriebene Briefe, alte Protokolle

- Medizinische Rezepte: handgeschriebenes Rezept in strukturierten Text umwandeln

- Schilder auf Touristenfotos: „Was steht auf diesem Schild?"

- Visitenkarten: Name, E-Mail, Telefonnummer aus einem Foto extrahieren

- Whiteboards: Brainstorming-Foto aus einem Meeting → digitaler Text

- Fotografische Rechnungen: Invoice schnell in der App verarbeitet

- Industrieinspektion: Lesen von Tags an Geräten auf Feldfotos

Technische Fallstricke

- Auflösung: vision-LLMs benötigen mindestens 512×512. Moderne Smartphone-Fotos sind ideal; niedrig aufgelöste Screenshots schlagen fehl.

- Ausrichtung: Ein um 90° gedrehtes Bild funktioniert, aber mit verringerter Genauigkeit — vorher drehen

- Hoher Kontrast hilft: Schwarz auf Weiß > Hellgrau auf Weiß > Grau auf Grau

- Fokus: Ein unscharfes Bild verschlechtert die Ergebnisse drastisch; gut aufnehmen oder eine professionelle Kamera verwenden

- Reflexionen: Foto eines Bildschirms mit Reflexion oder Schatten = Problem. Direkte Aufnahme oder Screenshots bevorzugen

Integrando über API

import httpx, base64

with open("foto.jpg", "rb") as f:

img_b64 = base64.b64encode(f.read()).decode()

r = httpx.post(

"https://api.brainiall.com/v1/chat/completions",

json={

"model": "claude-sonnet-4-6",

"messages": [{

"role": "user",

"content": [

{"type": "text", "text": "Extrahiere den Text aus diesem Bild in Markdown und bewahre dabei die Struktur."},

{"type": "image_url", "image_url": {"url": f"data:image/jpeg;base64,{img_b64}"}}

]

}]

},

headers={"Authorization": "Bearer brnl-xxx"}

)

print(r.json()["choices"][0]["message"]["content"])

Teste jetzt gleich

Im Brainiall-Chat klicken Sie auf die Dateianhang-Schaltfläche, senden Sie ein Bild mit Text und fragen Sie "extrahiere den Text aus diesem Bild". Ergebnis in 2-5 Sekunden. Pro für €5,49 beinhaltet 100 Analysen/Monat; Business schaltet Batch frei.