Upscale d'image en 4K sans perte de qualité

Pourquoi un "zoom" traditionnel floute toujours l'image

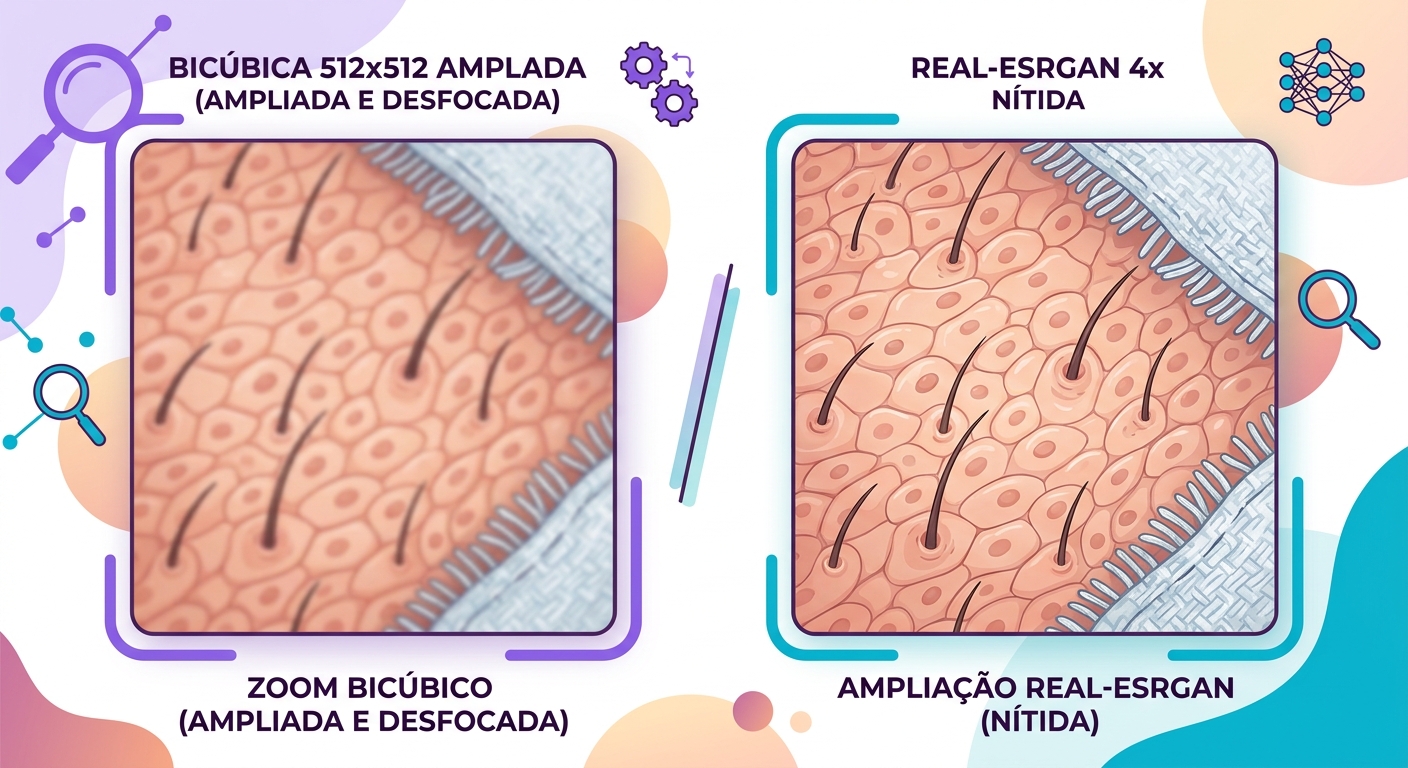

Quand vous agrandissez une photo dans Photoshop avec Bicubic ou Lanczos, l'algorithme remplit les nouveaux pixels comme une moyenne pondérée des voisins. C'est mathématiquement propre, mais le résultat est toujours flou — parce que l'information qui n'existait pas ne peut pas apparaître. Vous avez pris une image de 512×512 (262k pixels) et inventé les 768 000 pixels intermédiaires à partir de ce que vous aviez déjà.

L'IA moderne résout ce problème d'une façon fondamentalement différente : au lieu d'interpoler, elle génère ce qui s'y trouverait probablement. Des modèles comme Real-ESRGAN ont été entraînés sur des millions de paires (basse-rés, haute-rés) et ont appris à « halluciner » des détails plausibles — cheveux, peau, textures, contours — qui restent cohérents avec ce que vous voyez dans l'image originale.

Ce que le modèle « sait » sur les vraies photos

Real-ESRGAN et ses variantes ont été entraînés sur d'immenses datasets de photos à différentes échelles. Ils apprennent des priors statistiques — c'est-à-dire à quoi ressemblent « normalement » les pixels voisins dans une zone de peau, de tissu, de métal ou de feuillage. Quand vous lui soumettez une photo basse-rés, le modèle se dit : « cette région est probablement une joue ; en haute résolution, les joues présentent ces caractéristiques ».

C'est puissant, mais cela a un effet secondaire : le modèle va inventer des détails qui sembleraient corrects sans être fidèles à l'image originale. Pour des photos journalistiques ou forensiques, c'est problématique ; pour un usage créatif, c'est exactement ce que vous recherchez.

Quand utiliser Real-ESRGAN vs GFPGAN vs les autres

Le choix du modèle dépend de ce que vous agrandissez :

- Real-ESRGAN : usage général (photos, captures, graphiques). Produit une netteté plus « naturelle ». Coût computationnel modéré.

- GFPGAN : spécialisé pour les visages. Si votre image contient une personne, il vaut la peine de traiter les visages séparément — GFPGAN reconstruit les yeux, les bouches et les cheveux avec une qualité bien supérieure sur ces zones.

- SwinIR : alternative plus conservatrice — moins d'« hallucination », plus de fidélité. Idéal pour les images techniques ou les documents.

- Pipeline combiné : Real-ESRGAN pour l'image entière, puis GFPGAN appliqué uniquement aux zones de visage. Chez Brainiall, nous effectuons cette combinaison automatiquement dès que nous détectons des visages dans l'image.

Les limites à connaître

- Texte dans l'image : les petites lettres deviennent illisibles si l'input est trop dégradé. Le modèle « sait » à quoi ressemble du texte, mais ne peut pas lire ce qui était écrit — s'il est impossible de distinguer un B d'un 8 dans l'original, l'IA en choisit un et continue.

- Bruit amplifié : les photos très granuleuses verront leur grain « recréé » en même temps que les détails. Appliquez un denoise avant l'upscale pour un résultat propre.

- Artefacts JPEG : si l'original présente des blocs de compression JPEG visibles, le modèle peut les accentuer. Utilisez le preset « anti-artifact » lorsqu'il est disponible.

- Compositions stylisées : l'art, les peintures et les illustrations vectorielles peuvent ressortir « sur-photographiées » — utilisez des modèles dédiés à l'art (Real-ESRGAN Anime, par exemple) dans ces cas.

Les cas d'usage qui justifient l'effort

- Restauration de photos anciennes : 600×400 numérisée → imprimable en 4K

- E-commerce : photos fournisseur en basse résolution → haute qualité prête pour le web

- Print : images web pour bannière ou affichage extérieur sans pixelisation

- Archives anciennes : captures d'écran de jeux vidéo des années 90, vidéos enregistrées en VHS, etc.

Testez dès maintenant

Dans le chat Brainiall, envoyez une image basse-rés et demandez « fais un upscale en 4x de cette image ». Précisez dans votre prompt si l'image contient des visages (pour activer le GFPGAN combiné). Résultat en 3 à 8 secondes selon la taille. Le plan Pro à 29 R$ inclut 100 upscales par mois.