Ekstrak teks dari gambar dengan Vision AI

OCR berubah total di 2024-2026

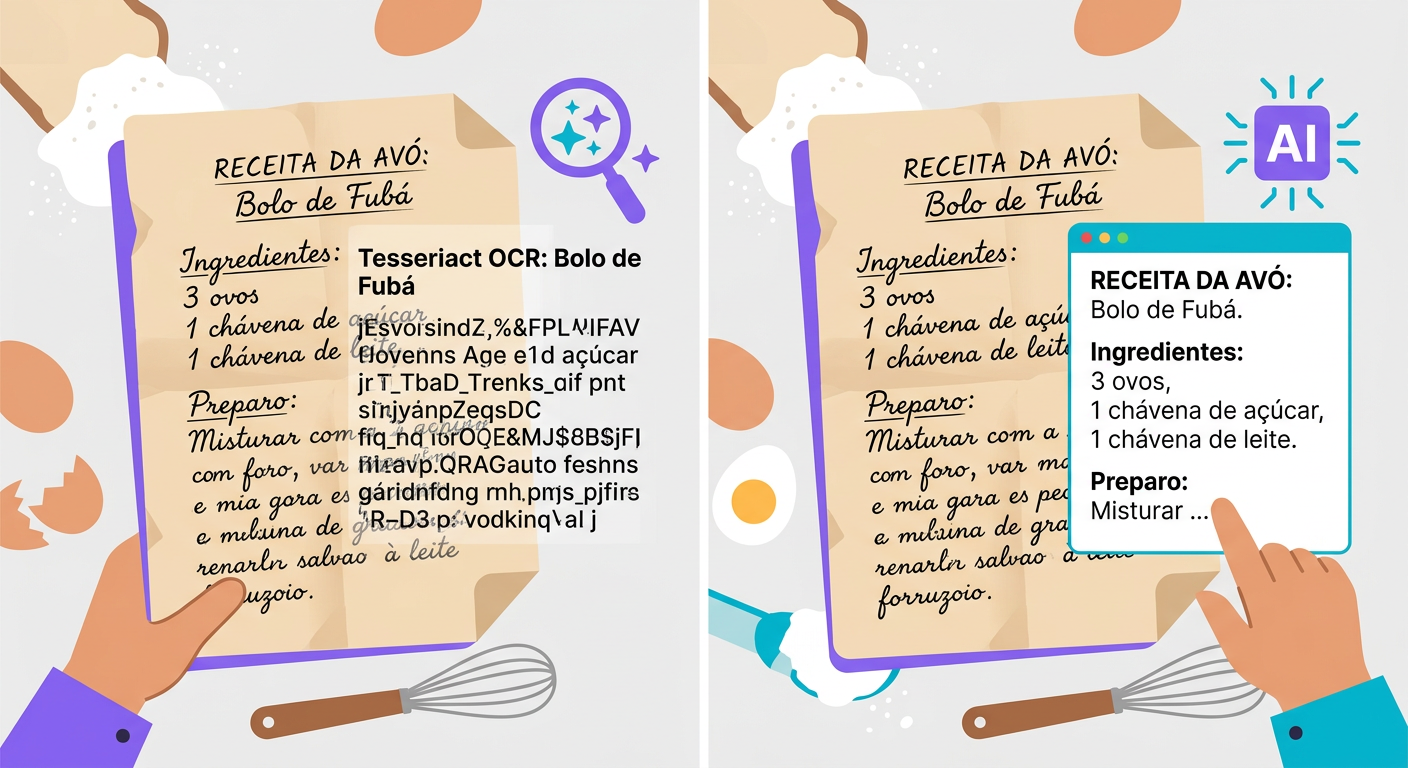

OCR tradisional (Tesseract, sejak 1985) bekerja dalam 2 langkah:

1. Deteksi: menemukan area gambar yang mengandung teks

2. Pengenalan: mengklasifikasikan setiap huruf satu per satu

Bekerja baik pada dokumen cetak yang bersih, dengan font umum, dalam bahasa Inggris. Dalam skenario lain (tulisan tangan, papan melengkung, teks dalam foto, bahasa eksotis, tata letak kompleks) akurasinya anjlok ke 60-70%.

Vision-language model modern (Claude Sonnet, GPT-5, Gemini 3 Pro) merevolusi OCR. Alih-alih mengklasifikasikan huruf per huruf, mereka menginterpretasikan gambar secara keseluruhan — mengenali konteks, mengoreksi kesalahan berdasarkan makna, dan menangani tata letak apa pun.

Kapan menggunakan setiap alat

Tesseract (open source, CPU lokal):

- Dokumen cetak terstandarisasi (invoice, PDF hasil scan)

- Volume tinggi (10k+ halaman/hari) di mana latensi penting

- Kasus di mana privasi mencegah pengiriman ke cloud

- Biaya: hampir nol

Vision-LLM (via API):

- Teks tulisan tangan

- Papan nama, poster, foto jalanan

- Teks pada objek 3D (kaleng, label melengkung)

- Dokumen dengan tata letak kompleks (tabel, banyak kolom, catatan kaki)

- Bahasa dengan sumber daya terbatas (Arab, Mandarin, Ibrani)

- Biaya: Rp 0,005 hingga Rp 0,05 per gambar

Whisper-OCR (model khusus):

- Dokumen dengan banyak tabel

- Persamaan matematika

- Tata letak ilmiah (paper)

Cara membuat request yang baik

Agar vision-LLM bekerja lebih optimal, susun prompt dengan baik:

Kurang baik:

> "OCR this"

Baik:

> "Ekstrak semua teks yang terlihat dalam gambar ini, pertahankan struktur hierarki (judul, subjudul, paragraf). Jika ada tabel, format dalam markdown. Jika teks tidak terbaca di suatu area, tandai [tidak terbaca]. Jika ada teks dalam beberapa bahasa, pisahkan."

Perbedaan kualitasnya sangat dramatis. LLM menggunakan "pemahaman" strukturnya untuk mengorganisasi output.

Kasus penggunaan praktis

- Digitalisasi arsip sejarah: surat tulisan tangan, notulen lama

- Resep medis: mengubah resep tulisan tangan menjadi teks terstruktur

- Papan dalam foto wisata: "apa yang tertulis di papan ini?"

- Kartu nama: mengekstrak nama, email, nomor telepon dari sebuah foto

- Whiteboard: foto brainstorm dalam rapat → teks digital

- Faktur foto: invoice yang diproses cepat di aplikasi

- Inspeksi industri: pembacaan tag pada peralatan dari foto lapangan

Jebakan teknis

- Resolusi: vision-LLM membutuhkan minimal 512×512. Foto dari smartphone modern sangat bagus; print resolusi rendah akan gagal.

- Orientasi: gambar yang diputar 90° tetap bisa diproses namun dengan akurasi berkurang — putar terlebih dahulu

- Kontras tinggi membantu: hitam di putih > abu-abu terang di putih > abu-abu di abu-abu

- Fokus: gambar buram menurunkan kualitas secara drastis; ambil foto dengan baik atau gunakan kamera profesional

- Pantulan: foto layar dengan pantulan atau bayangan = masalah. Lebih baik gunakan tangkapan langsung atau screenshot

Integrasi via API

`python

import httpx, base64

with open("foto.jpg", "rb") as f:

img_b64 = base64.b64encode(f.read()).decode()

r = httpx.post(

"https://api.brainiall.com/v1/chat/completions",

json={

"model": "claude-sonnet-4-6",

"messages": [{

"role": "user",

"content": [

{"type": "text", "text": "Ekstrak teks dari gambar ini dalam markdown, pertahankan strukturnya."},

{"type": "image_url", "image_url": {"url": f"data:image/jpeg;base64,{img_b64}"}}

]

}]

},

headers={"Authorization": "Bearer brnl-xxx"}

)

print(r.json()["choices"][0]["message"]["content"])`

Coba sekarang juga

Di chat Brainiall, klik ikon lampiran file, kirim gambar yang mengandung teks, dan ketik "ekstrak teks dari gambar ini". Hasilnya dalam 2-5 detik. Paket Pro Rp29 sudah termasuk 100 analisis/bulan; Business membuka fitur batch.