Görüntülerden metin çıkarın: Vision AI ile OCR

OCR 2024-2026'da tamamen değişti

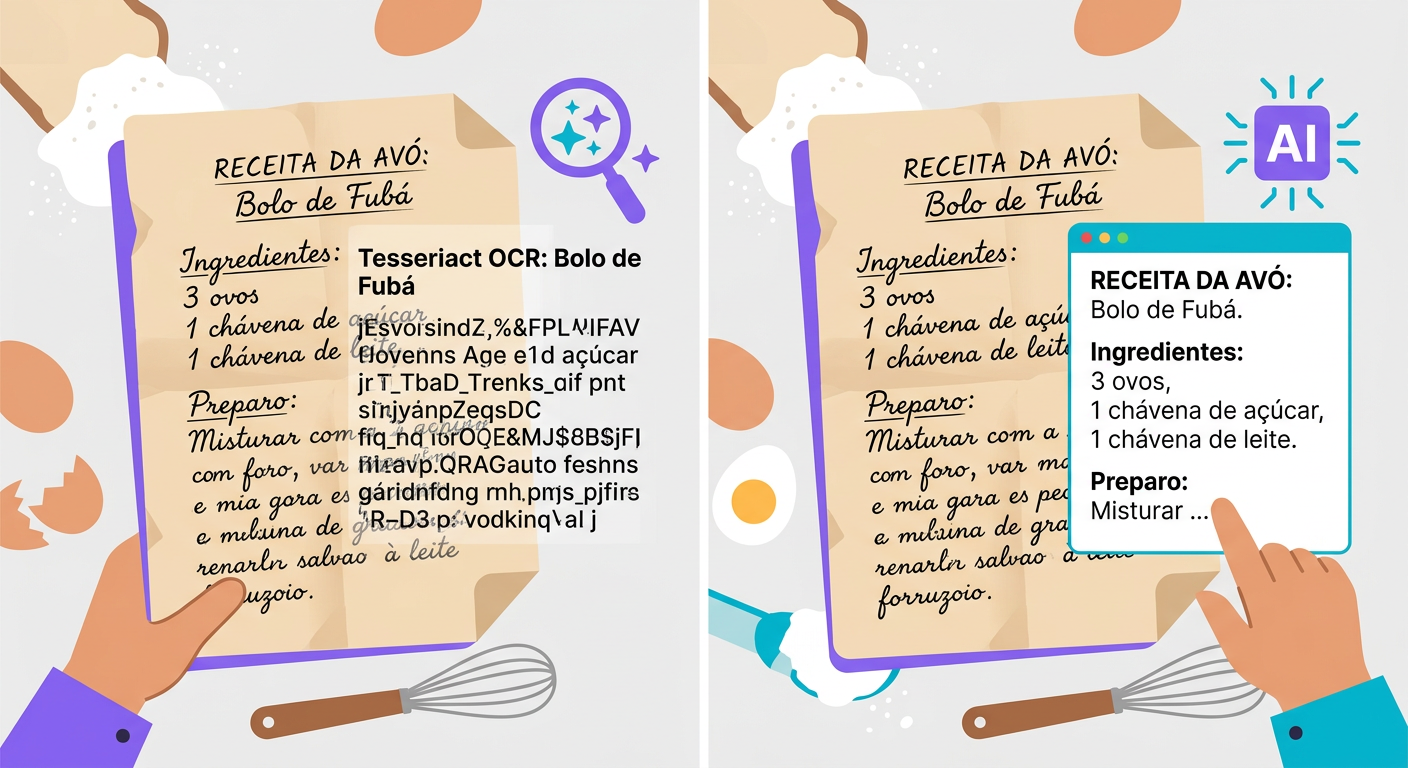

Geleneksel OCR (Tesseract, 1985'ten beri) 2 adımda çalışır:

1. Algılama: görüntüde metin içeren bölgeleri bulur

2. Tanıma: her harfi tek tek sınıflandırır

Temiz baskı belgelerinde, yaygın yazı tipleriyle ve İngilizce metinlerde iyi çalışır. Diğer senaryolarda (el yazısı, eğri tabelalar, fotoğraflardaki metinler, egzotik diller, karmaşık düzenler) doğruluk %60-70'e kadar düşer.

Modern vision-language modeller (Claude Sonnet, GPT-5, Gemini 3 Pro) OCR'ı kökten değiştirdi. Harfi harfe sınıflandırmak yerine görüntüyü bir bütün olarak yorumlarlar — bağlamı tanır, anlama dayalı hataları düzeltir ve rastgele düzenlerle başa çıkarlar.

Hangi aracı ne zaman kullanmalı

Tesseract (açık kaynak, yerel CPU):

- Standart baskı belgeler (faturalar, taranmış PDF'ler)

- Gecikmenin önemli olduğu yüksek hacimli işler (günde 10.000+ sayfa)

- Gizlilik nedeniyle buluta gönderilemeyen veriler

- Maliyet: neredeyse sıfır

Vision-LLM (API üzerinden):

- El yazısı metinler

- Tabelalar, afişler, sokak fotoğrafları

- 3D nesnelerdeki metinler (kutular, eğri etiketler)

- Karmaşık düzenli belgeler (tablolar, çoklu sütunlar, dipnotlar)

- Az kaynaklı diller (Arapça, Çince, İbranice)

- Maliyet: görüntü başına yaklaşık 0,001 - 0,01 $

Whisper-OCR (özel model):

- Çok sayıda tablo içeren belgeler

- Matematiksel denklemler

- Bilimsel düzenler (akademik makaleler)

Etkili bir istek nasıl hazırlanır

Vision-LLM'den en iyi sonucu almak için prompt'unuzu şu şekilde yapılandırın:

Kötü:

> "OCR this"

İyi:

> "Bu görüntüdeki tüm görünür metni çıkar; hiyerarşik yapıyı koru (başlık, alt başlıklar, paragraflar). Tablo varsa markdown formatında göster. Okunamayan bölgeler için [okunamıyor] yaz. Birden fazla dil varsa ayrı ayrı belirt."

Kalite farkı çarpıcıdır. LLM, yapıyı "anlayarak" çıktıyı düzenler.

Pratik kullanım senaryoları

- Tarihi arşiv dijitalleştirme: el yazısı mektuplar, eski tutanaklar

- Tıbbi reçeteler: el yazısıyla yazılmış reçeteleri yapılandırılmış metne dönüştürme

- Turistik fotoğraflardaki tabelalar: "Bu tabelada ne yazıyor?"

- Kartvizitler: bir fotoğraftan ad, e-posta ve telefon bilgilerini çıkarma

- Beyaz tahtalar: toplantı beyin fırtınası fotoğrafı → dijital metin

- Fotoğraflı faturalar: uygulamada hızlıca işlenen fatura

- Endüstriyel denetim: saha fotoğraflarındaki ekipman etiketlerini okuma

Teknik tuzaklar

- Çözünürlük: Vision-LLM'ler en az 512×512 piksel gerektirir. Modern akıllı telefon fotoğrafları idealdir; düşük çözünürlüklü ekran görüntüleri başarısız olabilir.

- Yönlendirme: 90° döndürülmüş görüntüler çalışır ancak doğruluk düşer — önceden döndürün

- Yüksek kontrast yardımcı olur: beyaz üzerine siyah > beyaz üzerine açık gri > gri üzerine gri

- Odak: bulanık görüntüler doğruluğu ciddi ölçüde düşürür; iyi çekim yapın veya profesyonel kamera kullanın

- Yansımalar: yansıma veya gölgeli ekran fotoğrafları sorun yaratır. Doğrudan çekim veya ekran görüntüsü tercih edin

API üzerinden entegrasyon

`python

import httpx, base64

with open("foto.jpg", "rb") as f:

img_b64 = base64.b64encode(f.read()).decode()

r = httpx.post(

"https://api.brainiall.com/v1/chat/completions",

json={

"model": "claude-sonnet-4-6",

"messages": [{

"role": "user",

"content": [

{"type": "text", "text": "Extraia o texto desta imagem em markdown, preservando estrutura."},

{"type": "image_url", "image_url": {"url": f"data:image/jpeg;base64,{img_b64}"}}

]

}]

},

headers={"Authorization": "Bearer brnl-xxx"}

)

print(r.json()["choices"][0]["message"]["content"])`

Hemen deneyin

Brainiall sohbet arayüzünde dosya ekleme simgesine tıklayın, metin içeren bir görüntü yükleyin ve "bu görüntüdeki metni çıkar" yazın. Sonuç 2-5 saniyede gelir. Pro plan ayda 100 analiz içerir; Business plan toplu işleme özelliğinin kilidini açar.