Yorumlarınızdaki Toksisiteyi Yapay Zeka ile Tespit Edin

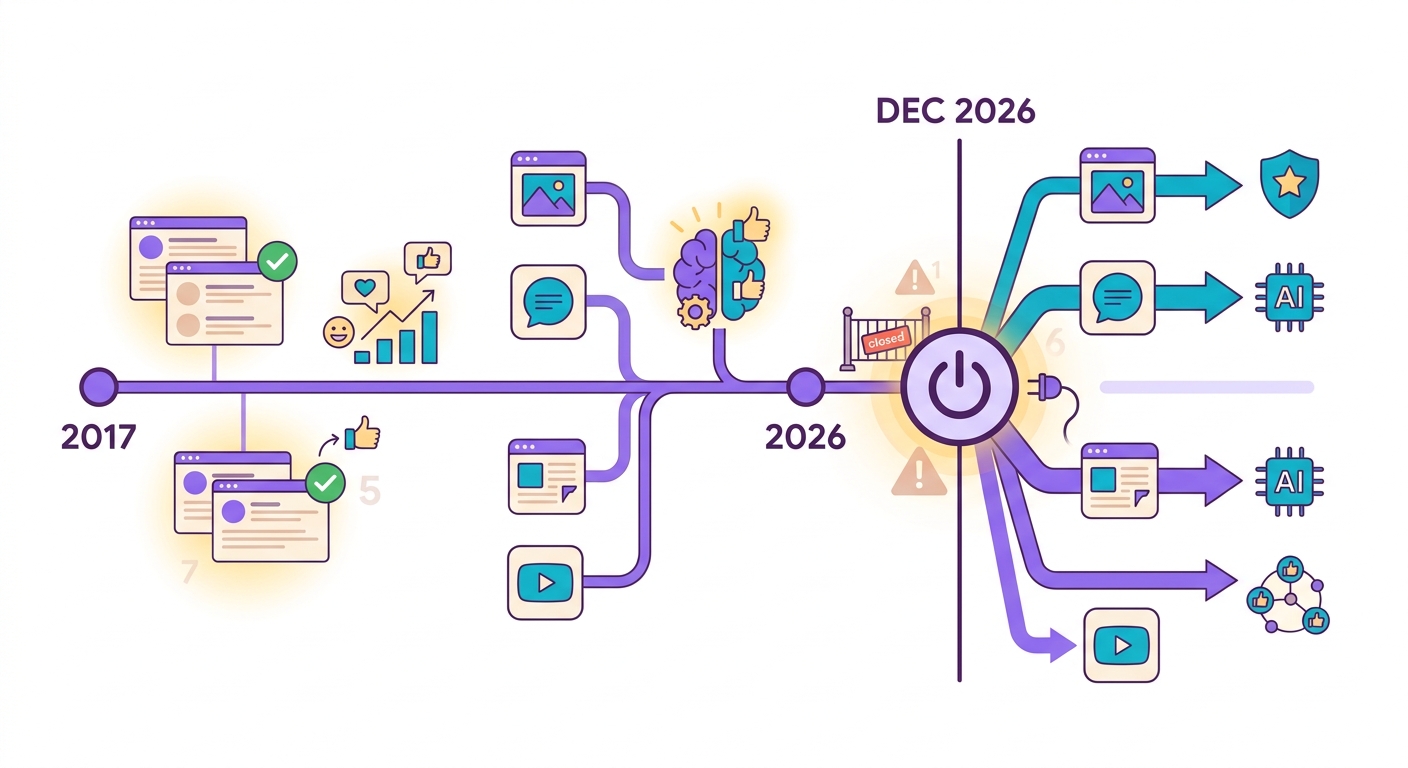

Perspective Kıyameti: Ne Oldu?

Ekim 2024'te Google, dünyanın en çok kullanılan ücretsiz toksisite tespit servisi olan Perspective API'nin Aralık 2026'da kullanımdan kaldırılacağını duyurdu. Bu servise bağımlı platformların (Reddit, New York Times, The Guardian ve binlerce forum) geçiş için 2 yılı var.

Sorun şu: Perspective ücretsizdi. Azure Content Safety ve AWS Comprehend gibi ticari alternatifler, 1.000 analiz başına 1 ABD Dolarından başlayan fiyatlar talep ediyor. Günde 100.000 yorum alan büyük bir forum için bu, yalnızca moderasyon için aylık 3.000 dolara dönüşüyor.

Brainiall, yerel CPU üzerinde ONNX ile çalışan Detoxify + Unitary modelleriyle moderasyon sunuyor; analiz başına maliyeti 0,001 TL'nin altında — 100 kat daha ucuz.

Önem Taşıyan 7 Kategori

Detoxify, metni 0 ile 1 arasında bir skorla 7 boyutta sınıflandırır:

1. Toxicity: Genel hakaret, saldırganlık

2. Severe toxicity: Tehdit, aşırı nefret

3. Obscene: Küfür ve kaba dil

4. Threat: Fiziksel şiddet tehdidi

5. Insult: Doğrudan kişisel saldırı

6. Identity hate: Gruba dayalı ayrımcılık (ırk, cinsiyet, din)

7. Sexual explicit: Cinsel açıdan露骨 içerik

Eşik değerlerini kendi politikanıza göre belirleyin. Yaygın bir örnek: severe_toxicity > 0,5 VEYA identity_hate > 0,6 VEYA threat > 0,3 ise engelle. Tek başına küfürler (obscene > 0,8) genellikle engellenmez, yalnızca uyarı alır.

Türkçe İçin Zorluklar

Detoxify İngilizce üzerine eğitilmiştir. İngilizce yorumlarda %95 ve üzeri başarı gösterir. Türkçe'de ise bu oran %75-85'e düşer; dile özgü bölgesel ifadeler ve argo (çoğu zaman hakaret içermeyen) modeli yanıltabilir.

Brainiall'da ek bir katman kullanıyoruz: şunları birleştiren bir hibrit sınıflandırıcı:

- Çok dilli Detoxify (kararın %70'i)

- Türkçeye özgü kelime listesi (%20)

- Sınır durumlar için küçük LLM (Gemma 3 veya benzeri) (%10)

Bu yaklaşım, Türkçe'de doğruluğu %92 ve üzerine çıkarırken gecikmeyi 80ms'nin altında tutar.

Yapay Zekanın Tehlikeli Biçimde Yanıldığı Durumlar

- Sarkasım: "Hayatımı mahvettiğin için çok teşekkürler!" — pozitif skor alır, ancak metin düşmancadır

- Meşru hiciv: Mizahi siyasi eleştiriler saldırı olarak işaretlenebilir

- Tıbbi bağlam: "Bu hastayı çok çalışmaktan öldüreceğim" (yorgun bir sağlık çalışanı) — yanlış pozitif uyarı

- Alıntılar: Irkçı bir gönderiyi eleştirmek amacıyla alıntılayan bir makale, ırkçı içerik gibi analiz edilir

- Kod değiştirme: İngilizce + Türkçe + emoji karışımı modeli şaşırtabilir

Pratik çözüm: Sınır durumlarda hard-block yerine otomatik skoru soft-moderation (yayınlamadan önce onay isteme) ile birleştirin.

Platformunuza Entegrasyon

Önerilen akış:

1. Kullanıcı yorum yazar → { text } ile POST /api/toxicity isteği gönderilir

2. API şunu döner: { toxicity, severe, threat, insult, identity_hate, obscene, sexual }

3. Kodunuz karar verir: engelle, uyar veya onayla

4. Uyarı durumunda yayınlamadan önce "Gözden geçirin — bazı kullanıcıları rahatsız edebilir" mesajı gösterilir

5. Engellemeler için log tutulur ve insan moderasyonuna bildirim gönderilir

%100 otomatik moderasyon yapmayın. Sınır durumlar için her zaman bir insan kuyruğu bulundurun.

Hemen Deneyin

Brainiall sohbet arayüzünde "bu yorumun toksisitesini analiz et: [buraya yapıştırın]" yazın. Ya da /api/nlp/toxicity rotasından API üzerinden erişin. 29 TL'lik Pro planı ayda 10.000 analiz içerir; Business planı ise öncelikli kuyruk ve milyonluk toplu işlem desteği sunar.