Integra Brainiall en tu app con Python o Node.js

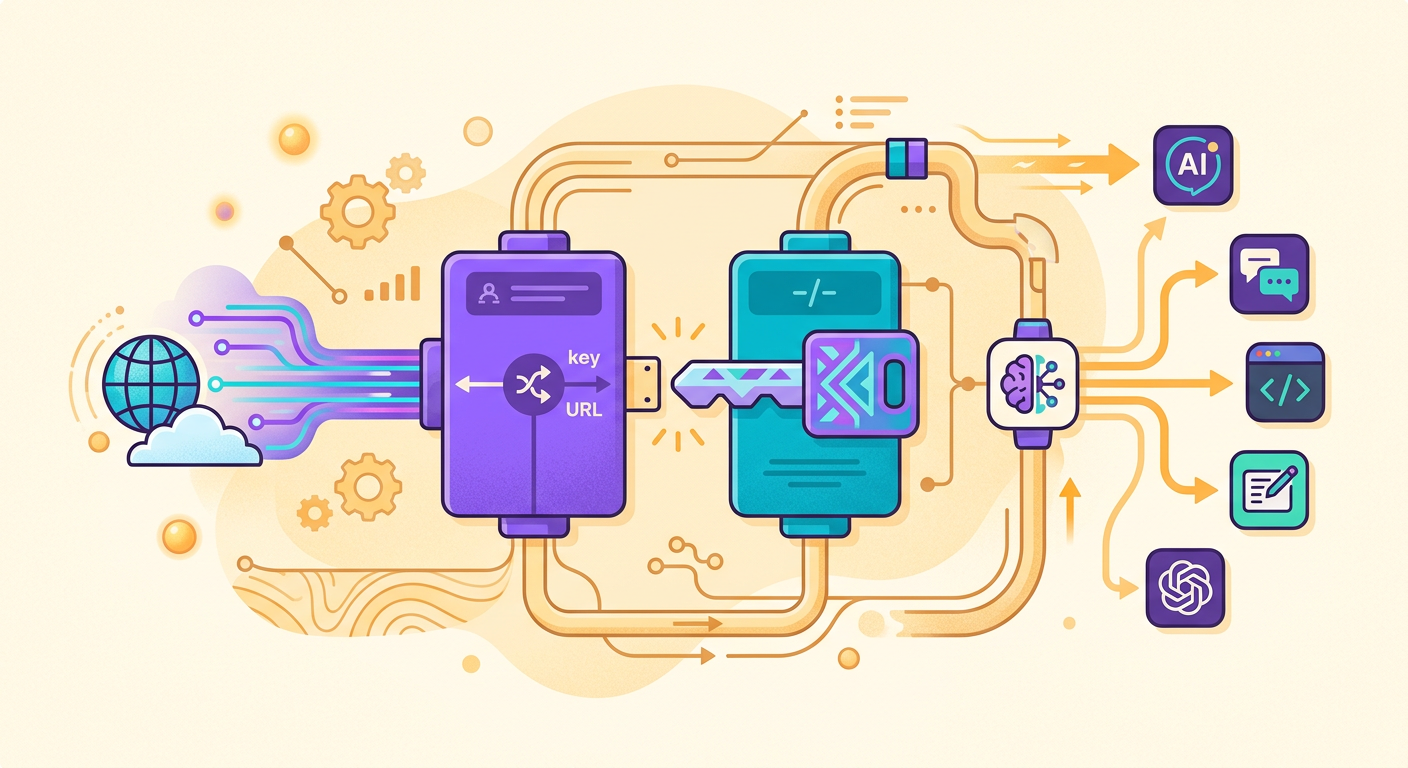

La API de Brainiall es compatible con OpenAI

Si ya sabes hacer requests a la API de OpenAI, sabes hacerlos a Brainiall. Solo cambian 2 cosas:

1. Base URL: https://api.brainiall.com/v1 (en lugar de https://api.openai.com/v1)

2. API Key: formato brnl-... (en lugar de sk-...)

Todo lo demás es idéntico. Tu código existente funciona con solo reemplazar esos dos valores.

Paso 1: crea tu API key

1. Accede a https://app.brainiall.com

2. Inicia sesión con Google (si es tu primera vez)

3. Menú → API Keys → "Crear nueva"

4. Dale un nombre descriptivo ("mi-app-prod" o similar)

5. Copia la key — solo aparece una vez, guárdala bien

El plan Pro incluye 1 key activa; Business incluye créditos + múltiples keys + rotación.

Paso 2: Python con httpx

`python

import httpx

BASE = "https://api.brainiall.com/v1"

KEY = "brnl-d13..." # tu key

def chat(prompt, model="claude-sonnet-4-6"):

r = httpx.post(

f"{BASE}/chat/completions",

json={

"model": model,

"messages": [{"role": "user", "content": prompt}]

},

headers={"Authorization": f"Bearer {KEY}"},

timeout=60

)

r.raise_for_status()

return r.json()["choices"][0]["message"]["content"]

print(chat("Explica TLS en 2 frases."))`

Paso 3: Python con el SDK oficial de OpenAI

`python

from openai import OpenAI

client = OpenAI(

base_url="https://api.brainiall.com/v1",

api_key="brnl-xxx"

)

r = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[{"role": "user", "content": "¡Hola!"}]

)

print(r.choices[0].message.content)`

El SDK de OpenAI funciona al 100% — soportamos streaming, function calling, tool_use, vision y todos los estándares de OpenAI.

Paso 4: Node.js

`javascript

import OpenAI from 'openai';

const client = new OpenAI({

baseURL: 'https://api.brainiall.com/v1',

apiKey: 'brnl-xxx'

});

const r = await client.chat.completions.create({

model: 'claude-sonnet-4-6',

messages: [{ role: 'user', content: '¡Hola!' }]

});

console.log(r.choices[0].message.content);`

Modelos disponibles

Usa el endpoint /v1/models para listarlos en tiempo real:

`python

r = httpx.get(f"{BASE}/models", headers={"Authorization": f"Bearer {KEY}"})

for m in r.json()["data"]:

print(m["id"])`

Categorías:

- Text: claude-sonnet-4-6, gpt-5, gemini-3-pro, llama-4-maverick, deepseek-v3, etc.

- Image: gemini-3-flash-image, gpt-5-image, flux-2-klein, seedream-4.5

- Video (endpoint separado /v1/videos): bytedance/seedance-2.0-fast

- TTS (endpoint /v1/audio/speech): 54 voces

- STT (endpoint /v1/audio/transcriptions): Whisper Large v3

Streaming (server-sent events)

`python

with httpx.stream("POST", f"{BASE}/chat/completions", ...

json={"model": "...", "messages": [...], "stream": True}

) as r:

for line in r.iter_lines():

if line.startswith("data: "):

# parsear chunk JSON

...`

El streaming reduce drásticamente la latencia percibida — los tokens aparecen a medida que se generan, en lugar de esperar la respuesta completa.

Rate limits y buenas prácticas

- Free tier API: no existe — la API requiere plan Pro o Business

- Pro: incluye chat + imagen vía portal, API de pago por uso

- Business: incluye créditos API mensuales ya incorporados

- Retry: usa backoff exponencial para errores 429/5xx

- Cache: guarda respuestas determinísticas localmente

- Timeout: 60s es seguro; para tareas largas como video, usa 300s

Errores comunes

- Olvidar el

Bearerantes de la key → 401 - Hardcodear la key en el código → riesgo de leak en un git push; usa variables de entorno

- No manejar el 429 → la aplicación se detiene

- Ignorar el campo

usageen la respuesta → sorpresas en la facturación - Usar el modelo equivocado para una tarea simple → costo 10x innecesario

Pruébalo ahora mismo

Crea tu key en https://app.brainiall.com y ejecuta uno de los ejemplos anteriores. El plan Pro es el mínimo para acceder a la API; el plan Business incluye créditos suficientes para empezar.